Description

Recension du livre par Paul Gosselin

Le livre de Gitt est structuré en trois grandes sections, soit : I) Les lois de la nature ; II) L’information et III) L’application du concept de l’information à la Bible. Gitt propose également trois annexes discutant des différentes perceptions de l’information en sciences, du langage comme code et comme support de stockage et de l’énergie. Discutant du concept d’information proposé par Shannon, Gitt note (2001 : 170)

Sa mesure de l’information, le “ bit ” (binary digit), avait l’avantage que les propriétés quantitatives d’une séquence de symboles peuvent être formulées. L’inconvénient est tout aussi évident : la définition de Shannon de l’information n’examine qu’un aspect mineur de la nature de l’information, comme nous le verrons en détail. La seule valeur de cet aspect particulier est de permettre de comprendre le processus de transmission et de stockage. Les questions du sens, de l’intelligibilité, de la justesse, de la valeur ou de l’inutilité ne sont pas considérées du tout. Les questions importantes sur l’origine (le transmetteur) et de sa destination (le récepteur) sont également ignorées. Car pour le concept de l’information de Shannon il est complètement indifférent de savoir si une séquence de symboles représente un texte extrêmement important et significatif ou si elle a été produite par un processus aléatoire. Il peut sembler paradoxal, mais dans cette théorie une séquence aléatoire de symboles représente la valeur maximale du contenu de l’information et la valeur correspondante ou quantitative d’un texte significatif de la même longueur sera plus faible.

En anecdote, Gitt relate (2001 : 45) le commentaire ironique d’un chercheur allemand au sujet du concept d’information de Shannon : “La théorie classique de l’information peut être comparée à l’affirmation qu’un kilo d’or a la même valeur qu’un kilo de sable! ” Effectivement, si l’on choisit de manière arbitraire un référent, tout s’équivaut… La signification du message n’a pas de place dans l’analyse de Shannon. Gitt, pour sa part, explique la chose de la manière suivante (Gitt 2001 : 116) :

La théorie de l’information de Shannon peut être considérée comme une extension de la théorie des probabilités. Il propose le bit comme l’unité de mesure de l’information, et ainsi un livre de 200 pages contient alors deux fois plus d’informations qu’un autre livre de 100 pages, si les pages contiennent le même nombre de lettres. La question de la signification est totalement ignorée. Wolfgang Feitscher a offert une description frappante de cette situation : “Lorsque l’on considère l’information sémantique, nous sommes comme un chimiste qui peut peser les substances, mais ne peut les analyser. » En ce sens, Shannon a résolu le problème de la pesée (ou la quantification) de l’information, mais la question de l’analyse n’a pas été abordée. Pour dépasser la théorie de Shannon, il est nécessaire de proposer des mesures de l’information sémantique qui doivent être valides de manière générale. Nous allons maintenant discuter de certains aspects qui pourront ouvrir la voie pour résoudre ce problème difficile (traduction par Paul Gosselin.)

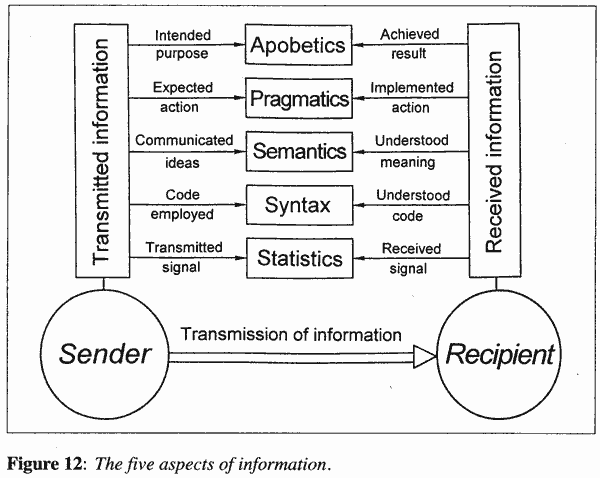

Ainsi, nous voyons que la question de la communication comporte plusieurs niveaux de complexité, niveaux qui posent tous problème pour le discours évolutionniste.

On le constate rapidement, la définition de l’information de Shannon n’examine que le niveau statistique ou quantitatif de la transmission de l’information. La définition de l’information de Shannon plaît aux évolutionnistes, car elle leur permet d’ignorer la question de fond, à savoir que ce qui est transmis doit être significatif. Dans son exposé classique sur le théorie de la communication, Shannon dit lui-même (1948 : 379) :

Le problème fondamental de la communication est celui de la reproduction à un moment précis ou approximatif d’un message sélectionné à un autre moment. Fréquemment, les messages ont un sens, c’est-à-dire qu’ils réfèrent ou sont corrélés, selon un certain système, à certaines entités physiques ou conceptuelles. Ces aspects sémantiques de la communication sont sans rapport avec la problématique traitée par les ingénieurs.

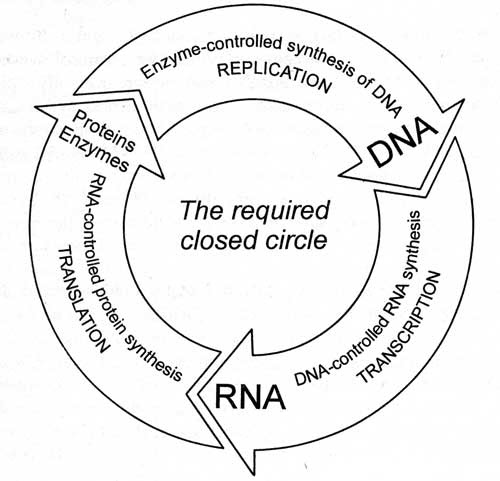

Mais il faut comprendre que Shannon examine la communication du point de vue de l’ingénieur qui veut exploiter au maximum la capacité de transmission d’un canal. Cela vise donc la compression du signal comme dans un fichier traité par Winzip ou Stuffit. Shannon se préoccupe donc d’une question légitime et nécessaire, mais qui est loin d’épuiser la question de la communication, peu importe le contexte, que ce soit dans le monde humain ou dans le monde biologique. L’on peut noter que Shannon ne mentionne pas ci-dessus la biologie ici, mais il existe un lien entre son affirmation et la biologie, car lors de la reproduction des instructions spécifiques sont nécessaires afin d’obtenir des structures biologiques spécifiques, qu’il s’agisse d’ailes, du processus en cascade de la coagulation ou d’une plaque photosensible dans un organisme unicellulaire. Dans un contexte d’ingénierie, si un entrepreneur veut construire un pont et que l’on lui remet les plans pour une cabine de toilettes, il est plutôt probable que son projet n’ira pas très loin…

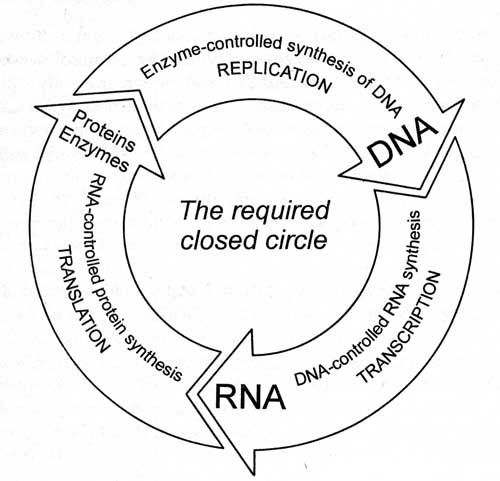

Et sans pousser à fond l’analyse présentée par Gitt dans son livre, voici un schéma qu’il propose exposant les cinq niveaux caractérisant la communication.

Je faisais allusion à une succession de gens fort compétents qui ont su trouver des expressions poétiques et creuses qui n’expliquent rien. C’est l’ordre par le bruit des cybernéticiens, les structures dissipatives d’un Prigogine, le systémisme d’un Varela, et maintenant le “bord du chaos” de Stuart Kauffman dont l’inanité sonore va bientôt nous parvenir en France. Ces écoles mettent la complexité à toutes les sauces. Elles évoquent à l’appui de leur démarche des exemples comme certaines réactions chimiques, le dessin d’une côte maritime, les turbulences atmosphériques ou la structure d’une chaîne de montagnes, dont la complexité est certes très grande, mais qui repose, au regard du monde vivant, sur un type d’organisation très pauvre, en tout cas non fonctionnelle [1]. Aucun algorithme ne nous permet d’appréhender la complexité du vivant, qui contrairement à tous ces exemples empruntés au monde physico-chimique est de nature fonctionnelle.

En terminant, je laisse le lecteur avec une pensée provenant d’un programmeur et ingénieur informatique fort compétent. Dans son livre The Road Ahead, Bill Gates affirme (1996 : 288) “L’ADN est comme un logiciel, mais bien, bien plus avancé que tout type de logiciel que nous avons créé jusqu’ici.”

Références

GATES, Bill (1996) The Road Ahead. (Edition révisée.) Blue Penguin Boulder CO.

SHANNON, Claude E. (1948) A Mathematical Theory of Communication. The Bell System Technical Journal, Vol. 27, pp. 379–423, 623–656, juillet, cctobre.

SCHüTZENBERGER, Marcel-Paul (1996) Entretien : Les failles du darwinisme. (Propos recueillis par Olivier Postel-Vinay), pp. 87-90. La Recherche, vol 96, n° 1.

YOCKEY, Hubert (1977) A Calculation of the Probability of Spontaneous Biogenesis by Information, pp. 377-398 Theory. Journal of Theoretical Biology, n° 67.

Notes

[1] – Du point de vue de la thermodynamique, ces structures sont des culs-de-sac, car elles sont incapables d’aucun travail utile. Du frimas sur une fenêtre en hiver au Québec, c’est joli, mais cela ne peut accomplir aucun travail utile. Ce sont des bibelots. Une structure fonctionnelle, comme la cellule, a la capacité de faire un travail utile et identifiable et de plus peut se reproduire. À ce titre, le cristal n’est pas une structure fonctionnelle, car bien qu’il comporte une forme de complexité (moléculaire), il ne peut accomplir un travail utile.